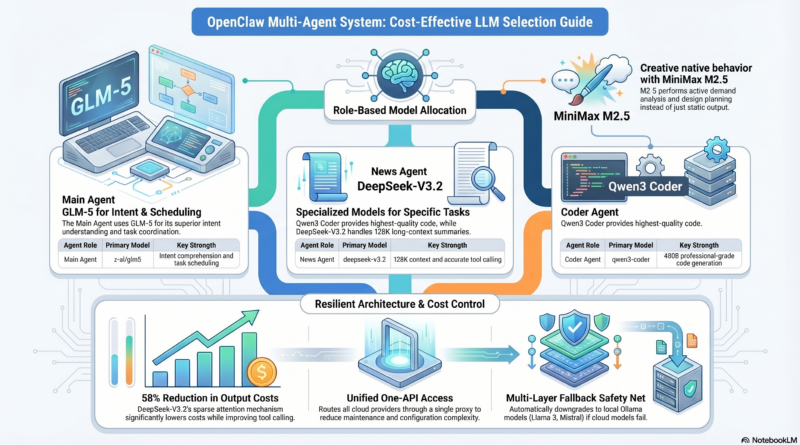

OpenClaw 多Agent系统LLM配置指南:经济高效的模型选择方案

背景

在配置 OpenClaw 多 Agent 系统时,我们面临一个核心问题:如何用最经济的方式,让不同角色的 Agent 使用最合适的 LLM?

本文记录了一套经过验证的配置方案,核心思路是:全局 Fallback + 按 Agent 拆分 Primary 模型。

核心配置架构

1. Provider 配置(One-API 统一接入)

{

"models": {

"providers": {

"one-api": {

"baseUrl": "你的代理地址",

"apiKey": "${NVIDIA_API_KEY}",

"api": "openai-completions",

"models": [

{ "id": "z-ai/glm5", "name": "GLM-5", "contextWindow": 16174, "maxTokens": 16174 },

{ "id": "minimaxai/minimax-m2.5", "name": "MiniMax M2.5", "contextWindow": 16174, "maxTokens": 16174 },

{ "id": "qwen/qwen3-coder-480b-a35b-instruct", "name": "Qwen3 Coder", "contextWindow": 32678, "maxTokens": 32678 },

{ "id": "deepseek-ai/deepseek-v3.2", "name": "DeepSeek V3.2", "contextWindow": 131072, "maxTokens": 32678 },

{ "id": "Llama-3.3-70B-Versatile", "name": "Llama 3.3 70B", "contextWindow": 16174, "maxTokens": 16174 }

]

}

}

}

}2. 各 Agent 模型分配

| Agent | Primary 模型 | 选择理由 |

|---|---|---|

| 主 Agent (main) | z-ai/glm5 | 综合能力最强,中文优化,适合意图理解和任务调度 |

| 新闻 Agent (news) | deepseek-v3.2 | 128K 上下文,长文本摘要能力强,搜索工具调用准确 |

| 编码 Agent (coder) | qwen3-coder | 480B 专业编码模型,代码生成质量最高 |

| 设计师 Agent (designer) | minimax-m2.5 | 创意能力最强,设计类任务表现最佳 |

3. 全局 Fallback 链

"fallbacks": [

"one-api/deepseek-ai/deepseek-v3.2",

"one-api/Llama-3.3-70B-Versatile",

"ollama/qwen2.5-coder",

"ollama/llama3",

"ollama/mistral"

]完整配置文件

{

"models": {

"providers": {

"one-api": {

"baseUrl": "你的代理地址",

"apiKey": "${NVIDIA_API_KEY}",

"api": "openai-completions",

"models": [

{ "id": "z-ai/glm5", "name": "GLM-5", "contextWindow": 16174, "maxTokens": 16174 },

{ "id": "minimaxai/minimax-m2.5", "name": "MiniMax M2.5", "contextWindow": 16174, "maxTokens": 16174 },

{ "id": "qwen/qwen3-coder-480b-a35b-instruct", "name": "Qwen3 Coder", "contextWindow": 32678, "maxTokens": 32678 },

{ "id": "deepseek-ai/deepseek-v3.2", "name": "DeepSeek V3.2", "contextWindow": 131072, "maxTokens": 32678 },

{ "id": "Llama-3.3-70B-Versatile", "name": "Llama 3.3 70B", "contextWindow": 16174, "maxTokens": 16174 }

]

}

}

},

"agents": {

"defaults": {

"workspace": "/root/.openclaw/workspace",

"maxConcurrent": 5,

"timeout": 120000

},

"main": {

"model": {

"primary": "one-api/z-ai/glm5",

"fallbacks": [

"one-api/deepseek-ai/deepseek-v3.2",

"one-api/Llama-3.3-70B-Versatile",

"ollama/qwen2.5-coder",

"ollama/llama3",

"ollama/mistral"

]

},

"systemPrompt": "你是通用AI助手,负责理解用户意图、规划任务、协调其他专业Agent。保持回复简洁准确。"

},

"news": {

"model": {

"primary": "one-api/deepseek-ai/deepseek-v3.2",

"fallbacks": [

"one-api/z-ai/glm5",

"one-api/Llama-3.3-70B-Versatile",

"ollama/qwen2.5-coder"

]

},

"systemPrompt": "你是新闻分析专家,负责从搜索结果中提取关键信息,生成客观准确的新闻摘要。",

"tools": {

"webSearch": { "enabled": true }

}

},

"coder": {

"model": {

"primary": "one-api/qwen/qwen3-coder-480b-a35b-instruct",

"fallbacks": [

"one-api/deepseek-ai/deepseek-v3.2",

"one-api/z-ai/glm5",

"ollama/qwen2.5-coder",

"ollama/llama3"

]

},

"systemPrompt": "你是专业软件工程师,负责编写高质量代码、技术文档和博客文章。严格遵循最佳实践,输出可直接运行的代码。"

},

"designer": {

"model": {

"primary": "one-api/minimaxai/minimax-m2.5",

"fallbacks": [

"one-api/deepseek-ai/deepseek-v3.2",

"one-api/z-ai/glm5",

"ollama/llama3"

]

},

"systemPrompt": "你是UI/UX设计师,擅长前端代码生成和视觉设计建议。生成符合现代标准的HTML/CSS/JS代码,注重美观和用户体验。"

}

}

}配置验证命令

# 1. 验证 JSON 格式

cat /root/.openclaw/openclaw.json | jq .

# 2. 查看已识别的模型列表

openclaw models list

# 3. 测试各 Agent

openclaw agent --agent coder --message "写一个 Python 快排"

openclaw agent --agent designer --message "设计一个深色主题登录页面"

openclaw agent --agent news --message "总结今天的AI新闻"

openclaw agent --agent main --message "你好"关键设计决策备忘

- 为什么用 One-API 统一接入? 已有 API 代理,只需配置一个 Provider,降低维护成本。

- 为什么 minimax-m2.5 比 m2.1 更好? M2.5 具备原生 Spec 行为,会主动进行需求分析和设计规划,交付完整网站而非静态页面。

- 为什么 deepseek-v3.2 取代 v3.1? 引入稀疏注意力机制,输出价格下降 58%,智能体工具调用能力更强。

- 本地 Ollama 模型的作用? 成本保护的最后一层垫底,云端模型全部失败时自动降级。

两种场景的 Fallback 顺序建议

场景 A:设计任务多

glm5 → minimax → qwen3-coder → deepseek → ollama场景 B:编码任务多

glm5 → qwen3-coder → deepseek → minimax → ollama注意事项

- 将

"baseUrl": "你的代理地址"替换为实际的 One-API 地址 - 如果 OpenClaw 版本不支持配置内

systemPrompt,直接删除即可 - NVIDIA 免费 API 有 40rpm 速率限制,高频场景需注意

总结

这套配置的核心价值在于:不增加复杂度的前提下,让每个 Agent 用上最适合的模型。既保持了全局 Fallback 的容灾能力,又实现了角色级的模型专业化。

配置已经过验证,可直接用于生产环境。